Startup AI China, DeepSeek, telah meluncurkan versi terbaru dari jaringan syarafnya, DeepSeek-V3.1. Model baru ini memperkenalkan dukungan untuk prosesor China, peningkatan kecepatan yang signifikan, dan mode hibrida yang baru. DeepSeek-V3.1 menggunakan jenis komputasi baru, UE8M0 FP8, yang mengurangi beban memori dan mempercepat pemrosesan data. Ini adalah perkembangan yang sangat penting mengingat semakin ketatnya pembatasan pada impor semikonduktor Barat.

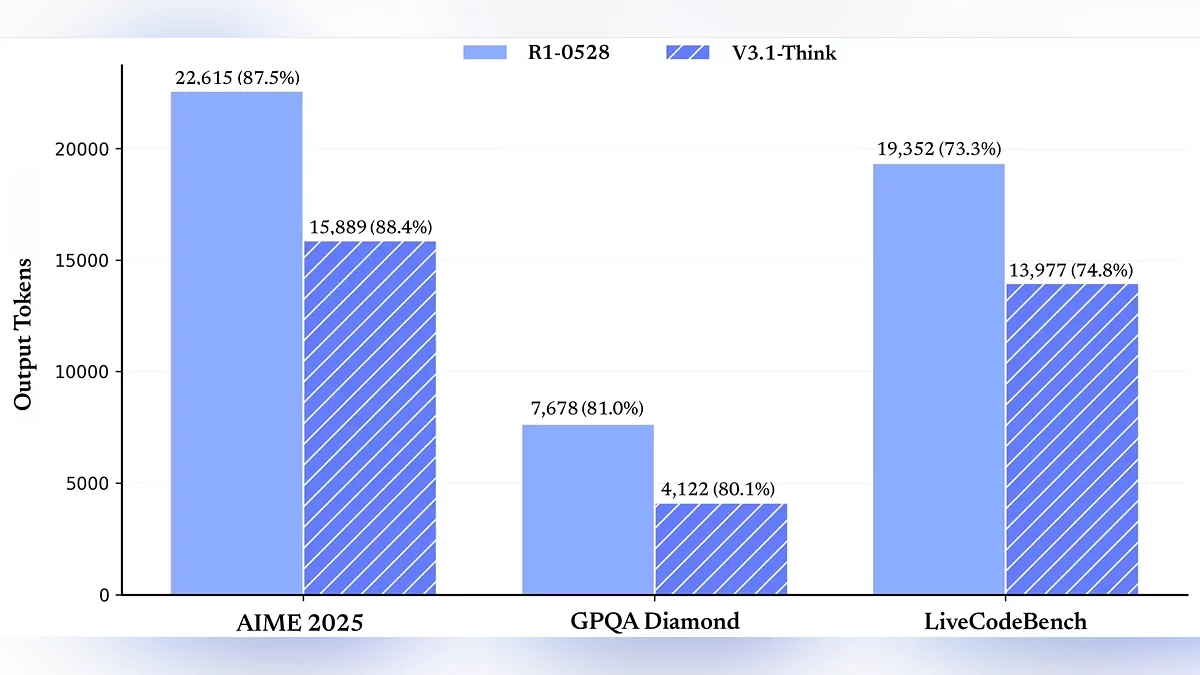

Menurut para penciptanya, model baru ini beroperasi 2,5 kali lebih cepat daripada pendahulunya dan mendukung jendela konteks sebesar 128K token—dua kali lipat dari model sebelumnya. Pengguna sekarang dapat beralih antara mode berpikir "dalam" dan standar dengan tombol di antarmuka, memungkinkan pengelolaan sumber daya model yang fleksibel berdasarkan tugas yang dihadapi.

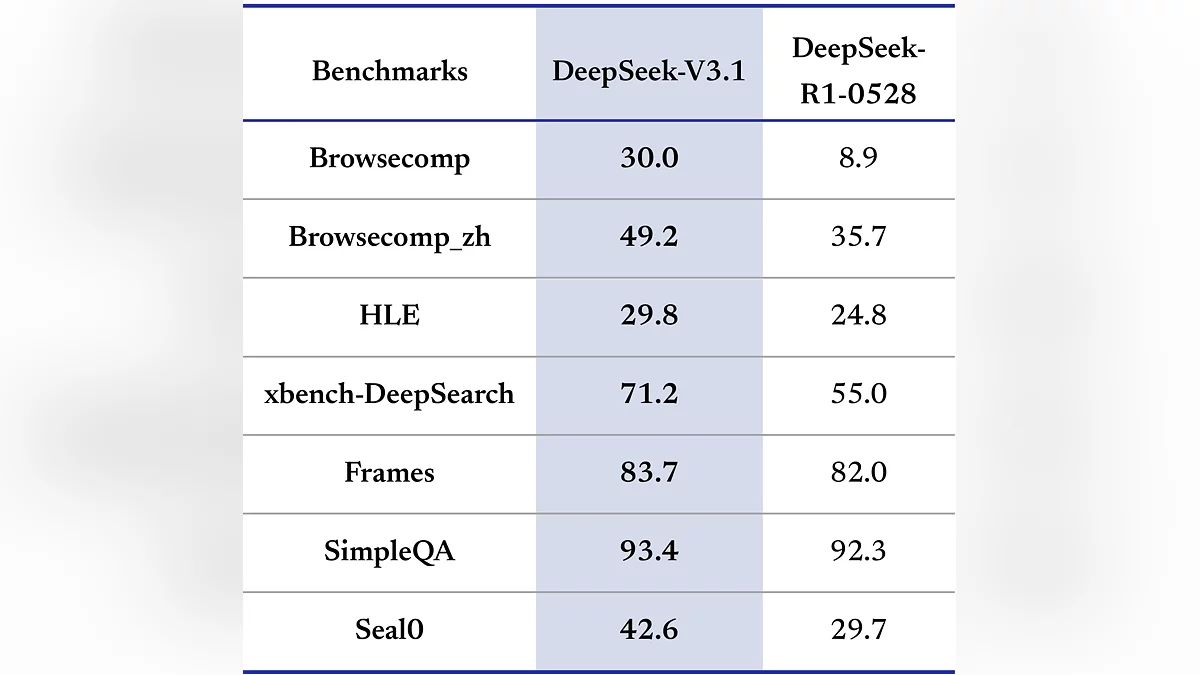

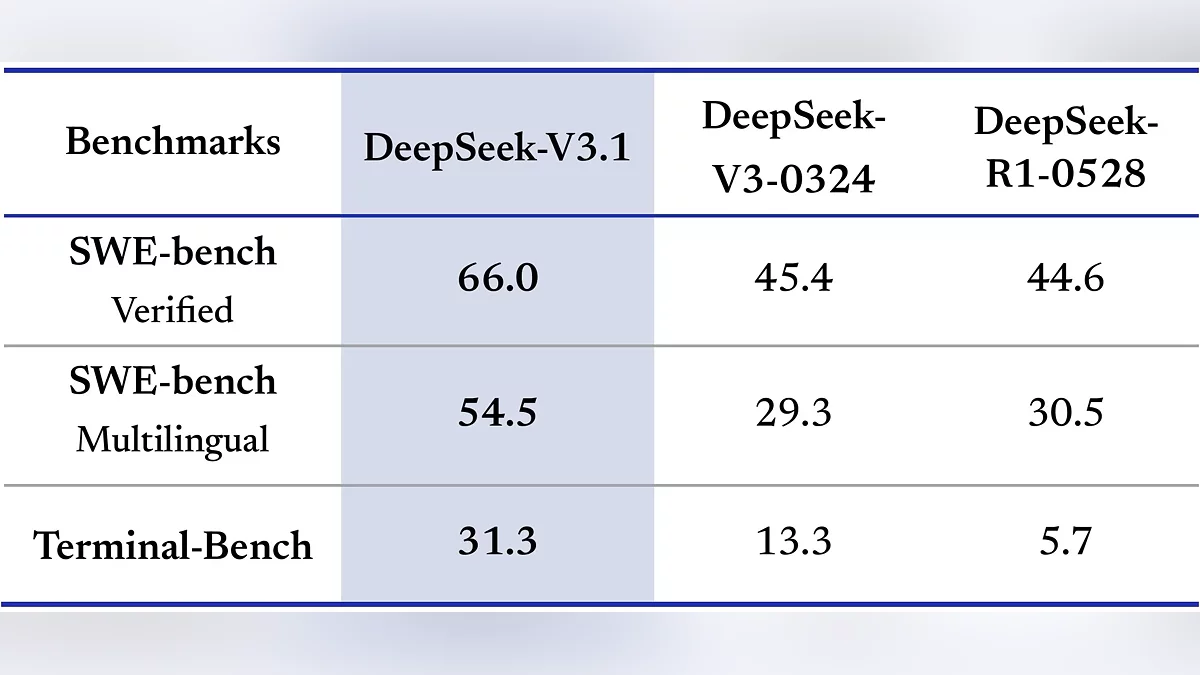

Model baru ini tetap sepenuhnya gratis untuk digunakan di antarmuka chat-nya. Untuk pengembang, harga akses API akan berubah: mulai 6 September, integrasi akan lebih murah dengan biaya $0,07 per 1 juta token input. DeepSeek-V3.1 telah mencatat skor benchmark yang mengesankan. Model ini mendapatkan skor 53,1% di SVG Bench, mengungguli Gemini 2.5 Flash dan GPT-5 Chat. Model ini juga mencapai skor 71,6% di tes ADA.

Model sumber terbuka ini tersedia untuk diunduh di Hugging Face, memungkinkan pengguna untuk menjalankannya secara lokal di perangkat keras mereka sendiri.

Rilis ini datang tidak lama setelah OpenAI meluncurkan model GPT-5 barunya pada awal Agustus. Meskipun versi dasarnya juga tersedia untuk semua pengguna tanpa langganan, peluncurannya mendapat kritik, mendorong perusahaan untuk mengembalikan akses ke model sebelumnya, GPT-4o, meskipun kinerja benchmark-nya lebih rendah.

-

![]() OpenAI Memperkuat Privasi ChatGPT: Enkripsi Chat dalam Pengembangan

OpenAI Memperkuat Privasi ChatGPT: Enkripsi Chat dalam Pengembangan -

![]() Free DeepSeek R1 Melonjak dalam Penalaran Logis — Hampir Menangkap ChatGPT Berbayar

Free DeepSeek R1 Melonjak dalam Penalaran Logis — Hampir Menangkap ChatGPT Berbayar -

![]() OpenAI Setuju untuk Mengembalikan GPT-4o Setelah Peluncuran GPT-5 yang Gagal, Merilis Patch Pertama

OpenAI Setuju untuk Mengembalikan GPT-4o Setelah Peluncuran GPT-5 yang Gagal, Merilis Patch Pertama -

![]() OpenAI AI Altman Mengalahkan Grok Musk 4-0 di Final Catur Kaggle

OpenAI AI Altman Mengalahkan Grok Musk 4-0 di Final Catur Kaggle -

![]() Model DeepSeek V3-0324 yang Baru Menantang GPT-4o dan Claude-3.5

Model DeepSeek V3-0324 yang Baru Menantang GPT-4o dan Claude-3.5 -

![]() AI OpenAI Memecahkan 6 Programmer Teratas di Seluruh Dunia di IOI 2025

AI OpenAI Memecahkan 6 Programmer Teratas di Seluruh Dunia di IOI 2025

Arkadiy Andrienko

Arkadiy Andrienko